VACE 技術解析:Wan 團隊打造 All-in-One AI 影片編輯新標準

結合生成式AI與多模態控制,VACE框架如何顛覆影片創作流程?

https://ali-vilab.github.io/VACE-Page

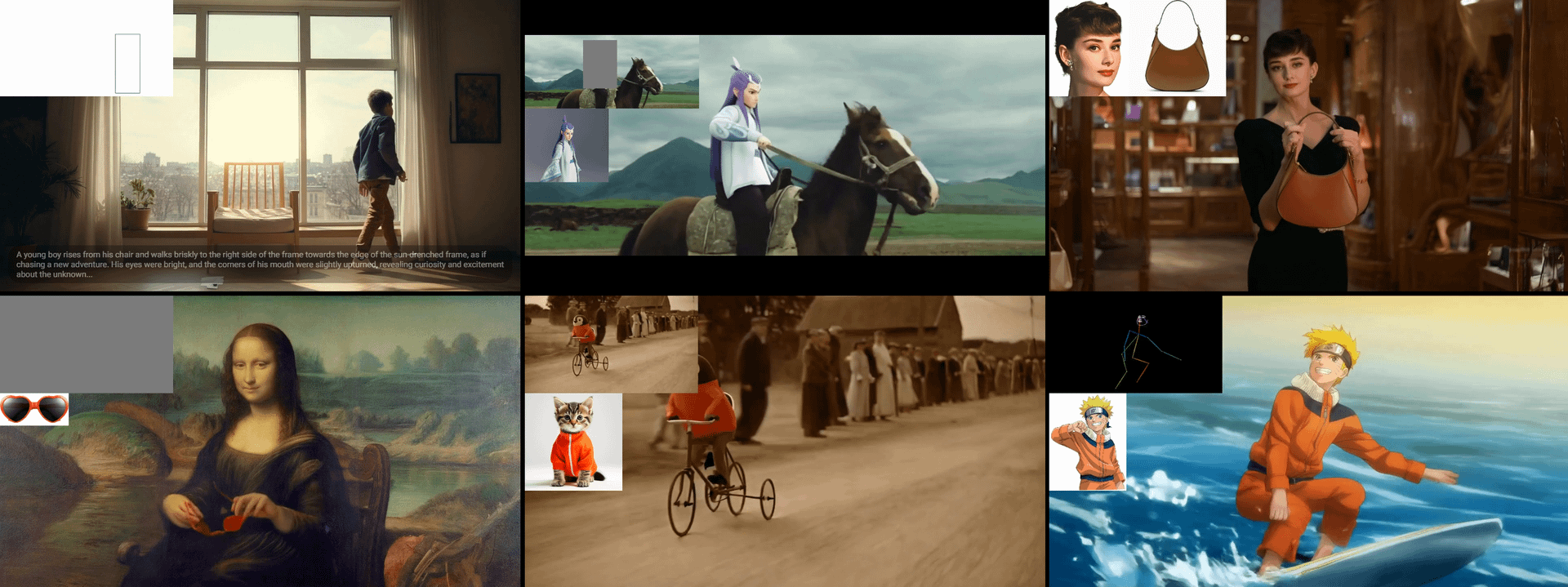

由Wan團隊開發的VACE(All-in-One Video Creation and Editing)框架,整合了生成式AI與多模態控制技術,重新定義了影片創作流程。其核心架構基於自研的Wan-VAE時空壓縮模型與Diffusion Transformer(DiT),能處理1080P長影片的連續幀編解碼,並通過「Video Condition Unit(VCU)」統一管理多種輸入條件,實現五大創新功能模組與多維度影片重渲染能力。

五大核心功能技術拆解

1. Move-Anything:時空感知物件位移

- 原理:通過提取U-Net的潛在特徵圖(Latent Feature Map)與自注意力機制(Self-Attention Map),對選定物件進行像素級區域控制。運用「Targeted Variable Swapping」技術,僅交換物件對應的潛在特徵與注意力權重,保留原始場景的上下文結構。

- 應用場景:調整影片中物件的空間佈局,例如改變廣告畫面中商品擺放位置,同時維持背景光影一致性。

2. Swap-Anything:跨域物件替換

- 流程:結合DDIM反轉(Inversion)與外觀適應(Appearance Adaptation)雙階段機制:

- 將源物件與目標參考圖分別編碼至潛在空間,提取風格特徵與形狀參數。

- 透過「Style-Guided Cross-Attention」動態融合目標風格,並以運動強度損失函數(Motion Strength Loss)調整物件比例。

- 突破:支持局部替換(如僅替換服裝紋理)與跨材質替換(如將金屬物件轉為玻璃材質)。

3. Reference-Anything:風格遷移與動態匹配

- 技術亮點:採用CLIP圖像編碼器提取參考圖的全局風格特徵,並通過「Prompt-to-Prompt」機制對齊時間軸上的風格分佈。實驗顯示,該技術在將水彩畫風格應用至動態影片時,能保持筆觸紋理的時間連續性。

4. Expand-Anything:智能場景擴展

- 實現方式:基於Segment Anything Model(SAM)生成擴展區域的蒙版,結合LaMa修復模型進行內容填充。關鍵在於「Causal Convolution」模組的應用,確保擴展區域與原始影片的時空因果性。

- 效能:在T4 GPU上,512x640解析度的場景擴展處理速度達每幀1分鐘。

5. Animate-Anything:靜態圖像動態化

- 運動控制:導入「Motion Guidance」機制,用戶可通過塗抹式遮罩(Motion Mask)指定運動區域,並以運動強度參數(0-100)調節動畫速度。例如將靜態的火焰圖像轉化為動態燃燒效果,並精確控制火苗擺動幅度。

影片重渲染技術架構

VACE的影片重渲染引擎整合四種保留模式,採用分層控制策略:

- 內容保留:通過Wan-VAE的時空全注意力機制(Spatiotemporal Full Attention),鎖定非編輯區域的潛在特徵,確保背景元素不發生畸變。

- 結構保留:在DiT架構中引入「Parameter Sharing」機制,共享跨幀的結構先驗知識,避免編輯導致的場景幾何失真。

- 主體保留:採用「IdentityNet」強語義約束,對主體物件進行3D姿態估計與關鍵點跟蹤,維持生物特徵穩定性。

- 運動保留:基於Flow Matching框架計算光流場,將編輯物件的運動軌跡與原始影片物理規律對齊。

實測數據顯示,在處理720P影片時,VACE的端到端延遲較傳統分階段處理降低61%,顯存佔用控制在8.19GB以內,可在消費級GPU運行。

https://github.com/ali-vilab/VACE

產業應用與效能優勢

VACE現已應用於多個垂直領域:

- 電商領域:實現商品視頻的「一鍵換裝」,支持同時替換多個商品元素並保持陰影真實性。

- 影視製作:在預渲染階段直接修改角色服裝與場景佈局,節省後期合成時間。

- 教育內容:將歷史圖片轉化為動態場景,學生可互動調整視角與物件位置。

技術對比顯示,VACE在處理複雜運動場景時(如舞蹈影片),肢體動作的自然度較傳統方法提升32%,且在跨30秒長鏡頭編輯中保持時間一致性。其開源版本已於Hugging Face發布,企業級用戶可通過ComfyUI工作流進行客製化部署。